Google постоянно следит за тем, чтобы пользователи получали качественный контент. Если раньше в топе выдачи были нечитаемые SEO-тексты, нашпигованные ключевиками, то сейчас поисковые системы строже следят за содержанием страниц — и инструментарий для этого у них заметно вырос.

С каждым обновлением Google совершенствует требования к сайтам: контенту, ссылочным профилям, техническим параметрам. Раньше всё это регулировалось отдельными фильтрами, сейчас большинство из них — часть основного алгоритма поисковой системы. В этом гайде по фильтрам Google разберём несколько вопросов:

- как определить наложение санкций Google;

- как точно выявить причины понижения позиций;

- как вывести сайт из-под фильтра гугла;

- как избежать ограничений в дальнейшем.

Во многом фильтры Google похожи на санкции «Яндекса». Поэтому для большей полноты картины рекомендуем ознакомиться со статьей о фильтрах Yandex.

- Алгоритмические системы и ручные санкции Google: в чём разница

- Как понять, что Google наложил фильтры на сайт

- Что делать, если сайт попал под фильтр «Гугла»

- Основные фильтры Google: история, диагностика и лечение

- Актуальные алгоритмические системы Google

- Дополнительные фильтры Google

- Неофициальные фильтры Google

- Инструменты для диагностики санкций Google

- Чек-лист: что нужно проверить, чтобы не попасть под фильтры Google

- FAQ: ответы на частые вопросы о фильтрах Google

Алгоритмические системы и ручные санкции Google: в чём разница

Это базовое разделение, которое важно понимать, чтобы не тратить время на бесполезные действия. Ручные санкции и алгоритмические понижения — это разные типы наказаний с разными сценариями восстановления.

|

Параметр |

Ручные санкции (Manual Actions) |

Алгоритмические системы |

|

Инициатор |

Сотрудник Google после ручной проверки |

Автоматические алгоритмы: Core Updates, SpamBrain, сигналы Helpful Content |

|

Где видно |

Google Search Console → «Проблемы безопасности и меры, принятые вручную» — есть уведомление с описанием нарушения |

В GSC уведомлений нет. Диагностика только по косвенным признакам: падение трафика, позиций, числа страниц в индексе |

|

Признаки |

Уведомление в панели вебмастера с конкретной причиной; резкое сокращение числа страниц в выдаче по оператору site: |

Одномоментное падение трафика или позиций, совпадающее с датой обновления алгоритма |

|

Путь восстановления |

Сценарий A: устранить нарушение → подать запрос на пересмотр (Reconsideration Request) в GSC |

Сценарий B: исправить проблемы → ждать следующей раскатки обновления (обычно 4–12 недель). Запрос на пересмотр здесь недоступен |

|

Сроки |

После подачи запроса: от нескольких дней до нескольких недель |

Зависит от частоты раскатки конкретного алгоритма: от 4 недель до нескольких месяцев |

Запрос на пересмотр санкций (Reconsideration Request) доступен только для ручных мер. Отправлять его после алгоритмического понижения — бессмысленно.

Как понять, что Google наложил фильтры на сайт

Для диагностики понадобится установить на сайт счётчик Google Analytics (GA4) и добавить ресурс в сервисы для вебмастеров: «Яндекс Вебмастер» и Google Search Console.

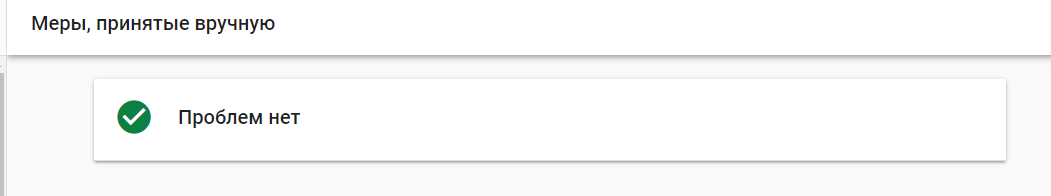

Проверка мер, принятых вручную

Проверить сайт на фильтры Google, наложенные вручную, можно в левом меню GSC, в разделе «Проблемы безопасности и меры, принятые вручную»:

Если здесь есть проблемы, в окне отображается уведомление с описанием — что именно нужно исправить. После исправления необходимо запросить перепроверку через Reconsideration Request. Если всё сделано правильно, специалист Google снимет ограничения.

Анализ поискового трафика

Если в GA4 наблюдается резкое снижение трафика, это тоже может быть признаком наложения санкций. Трафик снижается не только из-за фильтров: иногда виноваты сезонность или уменьшение поискового спроса. Отличительная особенность падения, связанного с санкциями Google, — одномоментная потеря существенной части переходов.

Если на графике видна конкретная дата, сопоставьте её с обновлениями алгоритмов. Официальные даты и статусы всех core updates публикует Google Search Status Dashboard и Google Search Central Blog. Алгоритм сопоставления простой:

- откройте Search Status Dashboard и зафиксируйте даты подтверждённых апдейтов;

- сопоставьте даты с аномалиями на графике кликов и показов в GSC;

- учтите, что раскатка обновления может занимать от нескольких дней до нескольких недель — не делайте поспешных выводов;

- для дополнительной сверки используйте внешние трекеры, например, Semrush Sensor.

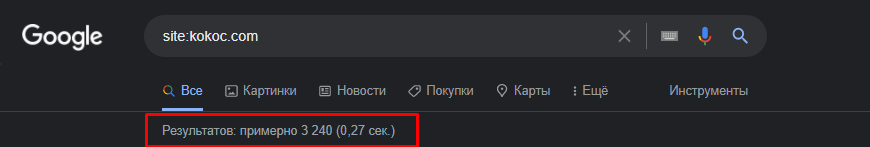

Проверка изменения числа страниц в индексе

Для быстрой оценки числа страниц в выдаче используем поисковик. В строку поиска вводим «site:название сайта» и смотрим на количество.

Существенное снижение числа страниц в индексе — повод анализировать ситуацию и сверяться с датами обновлений алгоритма.

Проверка позиций сайта с помощью сервисов

Существуют специальные SEO-инструменты, которые помогают быстро проверить позиции сайта в нужной ПС. Для этого выгружаем семантическое ядро, вводим имя домена и выбираем поисковую систему. Проверку нужно проводить периодически, чтобы оперативно отследить возможные проблемы с трафиком и быстро их устранить.

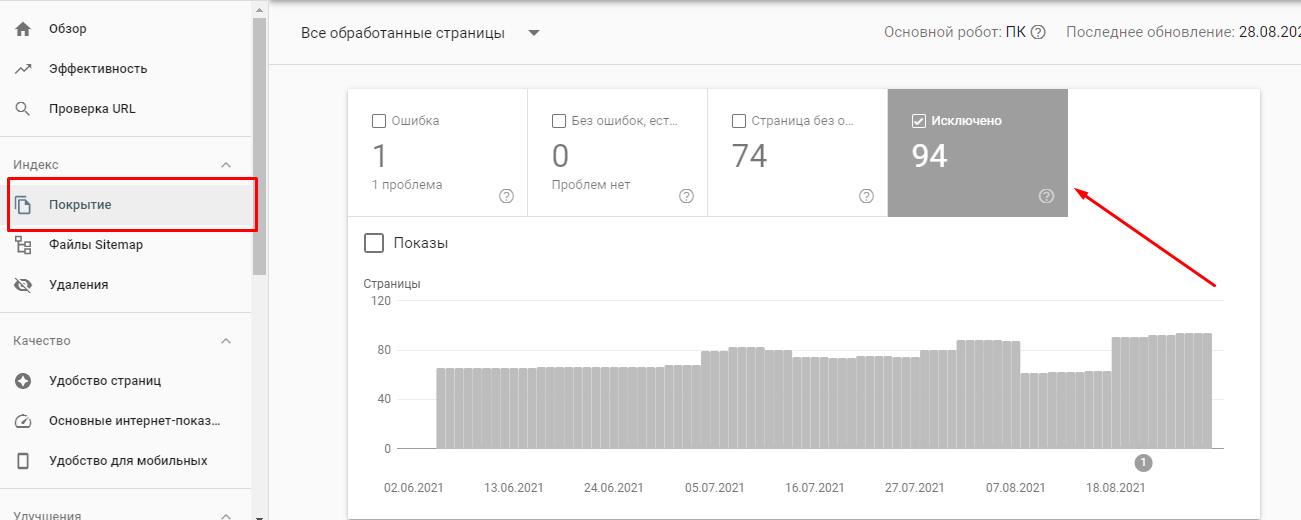

Позиции упали, страницы не в индексе — что делать дальше?

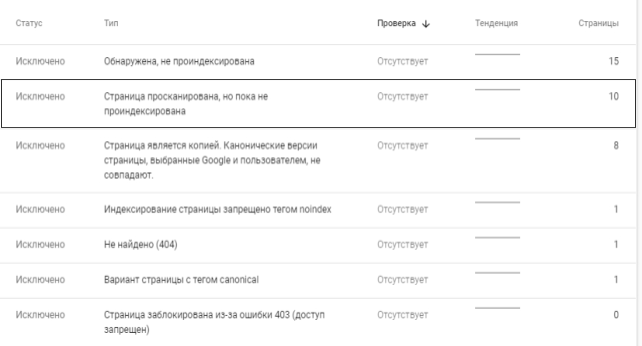

Дальше нужно проверить, какие именно страницы выпадают из индекса. Переходим в раздел «Покрытие» в GSC и смотрим отчёт по исключённым страницам.

Изучаем статусы и типы исключённых страниц:

Это, например, страницы, которые, вероятнее всего, попали под действие алгоритма Panda: поисковый робот их обошёл, признал контент недостаточно качественным и исключил из поиска.

Если количество исключённых из индекса страниц растёт — нужно перерабатывать содержимое сайта. Если количество индексируемых страниц не меняется, но посещаемость падает — стоит проверить ссылочный профиль и раздел ручных мер в GSC.

Что делать, если сайт попал под фильтр «Гугла»

Быстрый чек-лист из 7 шагов. Пройдите их последовательно — это позволит локализовать проблему и не тратить время на лишние действия.

- Шаг 1. GSC → Manual Actions. Зайдите в раздел «Меры, принятые вручную». Есть уведомление — работаем по Сценарию A (исправляем, подаём Reconsideration Request). Уведомлений нет — переходим к шагу 2.

- Шаг 2. Сопоставить даты с апдейтами. Открываем Google Search Status Dashboard, фиксируем даты обновлений и сверяем с датой падения трафика в GA4. Совпадение по времени — признак алгоритмического воздействия, работаем по Сценарию B.

- Шаг 3. Проверка индексации. Смотрим отчёт «Покрытие» в GSC и запрос site:домен в поиске. Выявляем исключённые страницы и их статусы.

- Шаг 4. Аудит контента по E-E-A-T. Проверяем страницы на глубину, уникальность, наличие экспертных сигналов. Тонкие и дублированные страницы — первые кандидаты на переработку.

- Шаг 5. Ссылочный аудит. Выгружаем внешние ссылки через GSC или Ahrefs/Semrush, оцениваем качество доноров. Спамные ссылки отклоняем через Disavow Tool.

- Шаг 6. Исправления и технический аудит. Устраняем 404-ошибки (исправляем ссылки или настраиваем 301-редиректы), убираем перегруженность рекламой, исправляем микроразметку.

- Шаг 7. Мониторинг 4–12 недель. После исправлений отслеживаем динамику трафика, позиций и индексации. Алгоритмическое восстановление требует времени — результат проявляется после следующей раскатки обновления.

Основные фильтры Google: история, диагностика и лечение

Google не зря считается лидером в борьбе с «чёрными» методами продвижения — поисковая система регулярно обновляет алгоритмы, чтобы улучшить выдачу. Начнём с основных фильтров, которые вошли в историю SEO.

Panda (Панда)

- Год выпуска: 2011.

- Что отслеживает: качество контента.

- Аналоги у «Яндекса»: «АГС», «Баден-Баден».

В 2011 году ПС запустила фильтр, который начал понижать в выдаче и исключать из индекса сайты с недостаточно качественным содержимым. Мы подробно описали в одной из своих статей работу фильтра «Панда».

Поймать этот фильтр сайт мог по причинам, связанным с качеством содержимого:

- Недостаточное количество контента. Особенно актуально для интернет-магазинов — карточки с отсутствующими или неинформативными описаниями могут полностью исключаться из индекса.

- Отсутствие чёткой тематики. Если на ресурсе размещается информация о разных темах, никак не связанных друг с другом, «Панда» могла посчитать его недостаточно качественным.

- Низкая ценность размещённой информации. Не стоит делать контент «чтобы был» — за водянистые малоинформативные тексты тоже можно было попасть под «Панду».

- Плохие поведенческие показатели. Сюда относится возврат на страницу выдачи после перехода на сайт. Если пользователь провёл на сайте мало времени и вернулся к ПС, система получает сигнал, что качество контента не удовлетворяет его запросам, и понижает позиции ресурса.

В состав «Панды» также вошли сигналы, которые раньше работали отдельно: Supplemental results (дополнительные результаты за неоригинальный контент), Over Optimization (переоптимизация) и Duplicate content (повторяющийся контент).

С 2016 года «Панда» не является самостоятельным фильтром, а её сигналы входят в основной алгоритм Google.

Как проверить и вывести сайт из-под фильтра «Панда»:

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Недостаточное качество или отсутствие информативного контента |

Выгрузить список исключённых из индекса страниц и наполнить их качественным содержимым |

Заполнять страницы до того, как они выйдут в индекс. Если этого сделать пока не получается — закрыть их тегом «noindex» |

|

Отсутствие чёткой тематики |

Вручную отобрать и удалить страницы, которые не соответствуют общей тематике сайта |

Не добавлять страницы с тематиками, которые не соответствуют основной теме сайта |

|

Плохие поведенческие показатели |

Проанализировать страницы с самыми короткими сеансами — выгрузить их можно через Google Search Console |

Проверять заполненность страницы, работу всех кнопок, ссылок и форм до того, как страница попадёт в индекс |

|

Повторяющийся контент |

Выгрузить список страниц с похожим контентом и оптимизировать их — объединить или скрыть от индексации |

Проводить кластеризацию более глубоко — хорошо прорабатывать интент, проверять вручную после автоматических кластеризаторов |

|

Низкая уникальность контента |

Проверить весь сайт на уникальность и заменить статьи с низкой оригинальностью |

Использовать несколько сервисов проверки уникальности перед размещением текстов на сайте |

Penguin (Пингвин)

- Год выпуска: 2012.

- Что отслеживает: ссылочный профиль.

- Аналог у «Яндекса»: «Минусинск».

Ссылочный профиль сайта всё ещё учитывается при ранжировании. За анализ внешних ссылок отвечал фильтр «Пингвин», который мы подробно разобрали в статье.

Этот фильтр охватывал все факторы, связанные с внешним ссылочным профилем. В отличие от «Панды», он понижал только определённую страницу в выдаче, тогда как «Панда» могла пессимизировать весь сайт.

За что можно было получить наложение «Пингвина»:

- избыточное использование ключевых слов в анкорах ссылок;

- скрытые ссылки в сквозных блоках;

- много входящих ссылок с некачественных доноров;

- наличие слов и текстов взрослой (adult) тематики.

В состав «Пингвина» также вошли алгоритмы, учитывающие равномерность прироста ссылок (Too many links at once) и их тематичность (Co-citation). Жёсткого процентного лимита прироста Google официально не устанавливал — важна плавность и качество. Стабильная динамика без резких всплесков сигнализирует об органическом развитии.

Как проверить и вывести сайт из-под фильтра «Пингвин»:

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Быстрое увеличение числа внешних ссылок |

Экспорт внешних ссылок через сервисы и ручная проверка каждого донора. Некачественные ссылки отключаем через инструмент Disavow Links. Важно: запрос на пересмотр санкций после работы со ссылками подаётся только если в GSC зафиксированы ручные меры за неестественные ссылки. При алгоритмическом понижении «Пингвином» нужно ждать следующей раскатки обновления. |

Сформировать корректный график прироста ссылочной массы без резких всплесков |

|

Наличие донорских ссылок на спамных и некачественных сайтах |

Не покупать спамные ссылки и периодически проводить аудит существующего профиля. Проверять доноров до покупки ссылки |

Актуальные алгоритмические системы Google

Panda и Penguin — история, важная для понимания логики ПС. Но сегодня ключевую роль в ранжировании и понижении сайтов играют другие системы. Они не называются «фильтрами» в традиционном смысле, но их воздействие на видимость сайта не менее серьёзно.

Core Updates (Обновления основного алгоритма)

- Периодичность: несколько раз в год.

- Что меняют: общую систему оценки качества сайтов и контента.

Core Updates — это масштабные обновления, которые переоценивают тысячи сайтов одновременно. Трафик может упасть или вырасти без каких-либо явных нарушений с вашей стороны — просто алгоритм начал иначе оценивать тематический авторитет или качество контента. Статусы и даты каждого апдейта публикует Search Status Dashboard.

Helpful Content signals (Сигналы полезного контента)

- Интегрировано в Core: с 2024 года.

- Что отслеживает: создан ли контент для людей или ради поисковых роботов.

Система Helpful Content теперь является частью основного алгоритма Core. Триггеры: низкий оригинальный вклад автора, переспамленные страницы, контент, написанный исключительно под ключевые запросы без реальной пользы для читателя, признаки массовой генерации с помощью ИИ без редакторской проработки.

SpamBrain (Антиспам-система)

- Запущена: 2022, активно развивается.

- Что отслеживает: ссылочный и контентный спам, манипуляции с доменами.

SpamBrain — основная система обнаружения спама Google на базе машинного обучения. Она выявляет манипуляции, которые сложно поймать статическими правилами. Ключевые параметры оценки: уровень мошеннических сигналов (scamness), ранг ссылочного спама (spamrank), флаг анкорного спама (IsAnchorBayesSpam).

Два ключевых триггера, введённых в спам-политиках 2024 года:

- Scaled content abuse (Масштабное злоупотребление контентом). Массовая генерация страниц с низкопробным или дублированным содержимым.

- Expired domain abuse (Злоупотребление устаревшими доменами). Покупка домена с историей для быстрого входа в индекс.

Page Experience и Intrusive Interstitials (Опыт взаимодействия со страницей)

- Активен: с 2021 года, вес в Core растёт.

- Что отслеживает: скорость загрузки, мобильную адаптацию, навязчивые поп-апы.

Page Experience объединяет группу сигналов: Core Web Vitals (LCP, INP, CLS), наличие HTTPS, мобильную пригодность и отсутствие навязчивых межстраничных элементов (interstitials). Страницы с поп-апами, которые перекрывают контент, теряют позиции прежде всего в мобильном поиске.

|

Система / сигнал |

Триггеры |

Симптомы |

Где проверить |

Первые шаги |

|

Core Updates |

Низкий E-E-A-T, тонкий контент, слабый авторитет домена |

Падение трафика по широкому кластеру запросов |

GSC → трафик + Search Status Dashboard |

Контент-аудит, усиление E-E-A-T, ожидание следующего апдейта |

|

Helpful Content |

Контент для роботов, ИИ-генерация без редактуры, переспам |

Потеря видимости по информационным запросам, сайт-уровневое понижение |

GSC → Покрытие + динамика трафика |

Переработка тонких страниц, добавление реального экспертного опыта |

|

SpamBrain |

Манипулятивные ссылки, анкорный спам, мошеннические сигналы |

Исключение страниц из индекса, резкое падение видимости |

GSC → Ручные меры + Disavow Tool + Ahrefs/Semrush |

Аудит ссылочного профиля, отклонение спамных ссылок через Disavow |

|

Page Experience / INP |

Медленная загрузка, навязчивые поп-апы, плохая мобильная версия |

Потеря позиций в мобильном поиске, снижение CTR |

PageSpeed Insights, GSC → Core Web Vitals |

Технический аудит, ускорение загрузки, удаление агрессивных поп-апов |

Дополнительные фильтры Google

Эти фильтры не влияют на позиции так существенно, как основные системы, но учитывать их всё равно стоит — они тоже направлены на отслеживание качества ресурса.

Алгоритм перегрузки рекламой

- Год выпуска: 2012.

- Что отслеживает: слишком много рекламы на первом экране.

Этот алгоритм, который в среде SEO-специалистов получил неофициальное название "Baby Panda", наказывает сайты, главный экран которых перегружен рекламными объявлениями. С 2024 года соответствующие сигналы интегрированы в Core и Page Experience: страницы, у которых значительная часть первого экрана занята рекламой, теряют позиции прежде всего на мобильных устройствах.

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Много объявлений на главном экране |

Отключить Adblock и оценить, насколько много рекламных блоков есть на главном экране; проверить PageSpeed Insights на мобильной версии |

Снизить количество блоков с рекламой, не перекрывать основной контент выше линии прокрутки |

Exact Match Domain (EMD)

- Год выпуска: 2012.

- Что отслеживает: прямое вхождение коммерческой ключевой фразы в домен.

Некоторые оптимизаторы считают, что дополнительное вхождение коммерческого ключа в домен может повысить позиции сайта в выдаче. Начиная с 2012 года эта хитрость не работает, сайт может потерять позиции. SpamBrain дополнительно учитывает сигнал exactMatchDomainDemotion при оценке ссылочного профиля.

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Точное вхождение одной или нескольких ключевых фраз в домен |

Менять домен с 301 редиректом |

При выборе доменного имени не использовать больше одного ключевого слова |

DMCA (Pirate, Пират)

- Год выпуска: 2012.

- Что отслеживает: копирование информации с других сайтов.

Этот фильтр похож на «Панду», но регулируется законом об авторском праве и защищает от копирования информации с других ресурсов. Если на сайт поступают жалобы о нарушении авторства, придётся удалять неуникальный контент и заменять его собственным.

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Копирование информации: текстовой, графической и видео с другого ресурса |

Удалить авторский контент и заменить его собственным. Можно поставить ссылку на первоисточник — это тоже может сработать (но не всегда) |

Не копировать чужой контент |

Спам в микроразметке

- Год выпуска: 2015.

- Что отслеживает: злоупотребление микроразметкой сниппета выдачи.

Качественная проработка сниппета повышает шансы на переход — наличие оценок и звёздочек рейтинга увеличивает доверие к ресурсу. Но некоторые специалисты этим злоупотребляют и размещают в разметке оценки и рейтинг там, где это не предусмотрено функционалом.

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Добавление в разметку сниппета несуществующих пунктов — оценок, звёздочек рейтинга |

Проверить разметку в GSC и отправить запрос на переобход |

Не пытаться манипулировать показами в выдаче |

Links (Ссылочная помойка)

- Год выпуска: неизвестен.

- Что отслеживает: количество исходящих ссылок с сайта.

Сигнал направлен против сайтов, которые размещают слишком много исходящих ссылок в рамках одной страницы. Такие ресурсы в среде SEO называют «ссылочными помойками» — они снижают общую оценку качества домена.

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Много ссылок на сторонние ресурсы |

Через Screaming Frog выгрузить список внешних ссылок, проверить и почистить |

Не добавлять ссылки на некачественных акцепторов, разнотематические ресурсы, не соответствующие тематике документа |

1.png)

Broken links (Битые ссылки)

- Год выпуска: неизвестен.

- Что отслеживает: количество страниц с кодом 404.

Этот сигнал направлен на определение качества сайта — он понижает в выдаче ресурсы, на которых слишком много страниц с кодом 404. Такое обычно возникает при удалении страниц или изменении URL. Если таких ошибок становится слишком много, общая оценка качества сайта снижается.

|

Нарушение |

Проверка и устранение |

Профилактика |

|

Много битых ссылок |

Выгрузить список ошибок через GSC или Screaming Frog. Удалить или исправить неработающие внутренние ссылки; настроить 301-редирект на существующую страницу. Использовать nofollow для внутренних 404 не нужно — это не решает проблему. |

При изменении адресов страниц сразу настраивать 301-редирект. Регулярно проводить технический аудит сайта и удалять несуществующие ссылки и страницы |

Неофициальные фильтры Google

Сюда относятся ограничения, которые представители Google не подтвердили официально, но их наличие зафиксировали SEO-специалисты по всему миру.

-5, -30, -950

Падение в выдаче за использование методов «чёрного SEO». Отмечается уменьшение позиций на 5, 30, 950 пунктов. Применяется в отношении таких нарушений:

- клоакинг;

- дорвеи;

- использование SEO-ссылок;

- применение скрытых редиректов.

Отличительная особенность фильтра состоит в том, что если нарушения не устранить, сайт сначала потеряет позиции, а после и вовсе вылетит из индекса.

Инструменты для диагностики санкций Google

Ниже — базовый набор, который закрывает большинство задач по диагностике и помогает в выводе сайта из-под фильтра Google.

|

Инструмент |

Назначение |

Тип |

Ключевые метрики / функции |

Когда использовать |

|

Google Search Console |

Диагностика ручных мер, индексации, трафика |

Бесплатный |

Manual Actions, Coverage, Core Web Vitals, клики/показы |

Первый шаг при любом подозрении на санкции |

|

Google Analytics 4 (GA4) |

Анализ трафика и поведенческих факторов |

Бесплатный |

Сессии, отказы, время на сайте, источники трафика |

При резком падении переходов из органики |

|

Google Search Status Dashboard |

Сопоставление дат падения с апдейтами |

Бесплатный |

Даты и статусы всех Core Updates |

Для определения алгоритмической причины просадки |

|

Screaming Frog |

Технический аудит: ошибки, ссылки, метатеги |

Freemium |

404, редиректы, дубли, внешние и внутренние ссылки |

При аудите битых ссылок и технических проблем |

|

Ahrefs |

Ссылочный аудит, анализ конкурентов, трекинг позиций |

Платный |

DR, ссылочный профиль, анкоры, динамика ссылок |

При подозрении на Penguin / SpamBrain |

|

Semrush |

Мониторинг позиций, ссылочный и контентный аудит |

Платный |

Authority Score, Toxic Score, Sensor (волатильность) |

При комплексном SEO-аудите и отслеживании апдейтов |

|

Disavow Tool (GSC) |

Отклонение спамных ссылок |

Бесплатный |

Загрузка файла с доменами/URL для отклонения |

После выявления некачественных доноров |

|

PageSpeed Insights |

Проверка Core Web Vitals и скорости загрузки |

Бесплатный |

LCP, INP, CLS, оценка производительности |

При проблемах с Page Experience и мобильным поиском |

Чек-лист: что нужно проверить, чтобы не попасть под фильтры Google

Это универсальный список, который можно использовать как для систематических аудитов, так и для проверки новых сайтов. Он не является полной версией SEO-аудита, но помогает избежать основных проблем.

- Проверка уникальности размещённых текстов.

- Проверка текстов на естественность и отсутствие переспама.

- Проверка полноты информации, опубликованной на сайте, и её соответствия принципам E-E-A-T.

- Выгрузка и анализ исключённых из индекса страниц.

- Выгрузка и проверка внешних ссылок — исключение некачественных доноров через Disavow Tool.

- Оценка количества рекламных блоков на сайте, особенно на первом экране.

- Проверка доменного имени на вхождение ключевой фразы.

- Проверка семантики и её дополнение словами из подсветок и подсказок.

- Проверка сниппета выдачи и корректности микроразметки через GSC.

- Анализ исходящих ссылок с ресурса — их количество и качество.

- Анализ количества страниц с кодом 404, настройка редиректов или удаление битых ссылок.

- Сопоставление дат падения трафика с обновлениями алгоритмов через Search Status Dashboard.

- Проверка Core Web Vitals (LCP, INP, CLS) через PageSpeed Insights.

FAQ: ответы на частые вопросы о фильтрах Google

Как понять, что сайт попал под фильтр гугла, а не просто упал трафик из-за сезонности?

Сезонное падение — плавное, растянутое на недели. Если трафик рухнул одномоментно и дата падения совпадает с датой Core Update в Search Status Dashboard — это признак алгоритмического воздействия. Также проверьте раздел «Меры, принятые вручную» в GSC: если там появилось уведомление — сайт получил ручные санкции Google.

Нужно ли подавать Reconsideration Request после работы с ссылочным профилем?

Только если в GSC зафиксированы ручные меры за неестественные ссылки. Запрос на пересмотр санкций недоступен после алгоритмического понижения — например, после воздействия Penguin, который с 2016 года встроен в основной алгоритм. В этом случае нужно устранить нарушения и ждать следующей раскатки обновления.

Можно ли закрыть внутренние страницы с ошибкой 404 тегом nofollow?

Нет. Nofollow не устраняет ошибку 404 и не восстанавливает краулинговый бюджет — поисковый робот всё равно будет обращаться к несуществующей странице. Правильное решение: исправить внутренние ссылки, настроить 301-редирект на существующую страницу или удалить ссылки на уже несуществующие адреса.

Где Google официально публикует информацию об обновлениях алгоритмов?

Официальные анонсы и статусы всех Core Updates публикует Google Search Status Dashboard и Google Search Central Blog. Сторонние ресурсы, включая Moz, Ahrefs и Semrush Sensor, дают дополнительный контекст, но не являются первоисточником.

Как долго восстанавливается сайт после алгоритмических санкций Google?

Зависит от типа нарушений и частоты раскатки обновлений. В среднем — от 4 до 12 недель после устранения проблем. Иногда дольше: если сайт попал под воздействие Core Update, восстановление заметно проявится только после следующего крупного апдейта. Снятие санкций и возврат позиций может занять до 6 месяцев.

Что такое SpamBrain и чем он опасен для продвижения сайта?

SpamBrain — это система обнаружения спама на базе машинного обучения. Она выявляет манипулятивные ссылки, анкорный спам, мошеннические сигналы и признаки масштабной генерации контента. Сайты, попавшие под её воздействие, теряют позиции и видимость — без уведомления в GSC.

Что такое Helpful Content и как он влияет на ранжирование?

Helpful Content — это набор сигналов, интегрированный в основной Core-алгоритм Google. Система оценивает, создан ли контент для людей или ради поисковых роботов. Страницы с низким оригинальным вкладом автора, признаками массовой ИИ-генерации без редактуры и переспамом — в зоне риска. Восстановление возможно через переработку контента и усиление E-E-A-T сигналов.

1.png)

1.png)

1.png)

1.png)

1.png)

1.png)

.png)

.png)

.png)

Комментарии (7)

Оставить комментарий