Иногда возникает необходимость убрать сайт или его отдельную страницу из поисковой выдачи. Причины могут быть разными: от смены домена и скрытия разделов в разработке до удаления неактуального контента. Главная задача — сделать так, чтобы конкретный URL стал недоступен для пользователей из поиска. Разберем основные способы, как исключить ненужный контент из индекса поисковых систем и когда это действительно требуется.

- Быстрый выбор способа удаления сайта

- Зачем может потребоваться удалить сайт из поиска

- Удаление страницы из «Яндекса»

- Навсегда удалить страницу или файл (404/410 + X‑Robots‑Tag)

- Удаление сайта из «Яндекса» через robots.txt

- Через метатеги

- Удаление сайта из Google

- Полезные советы

- Коротко о главном

Быстрый выбор способа удаления сайта

Прежде чем погружаться в технические детали, стоит определить, какой метод подходит для вашей задачи. Этот быстрый анализ поможет выбрать нужный инструмент и оценить риски, чтобы не навредить SEO-продвижению основного сайта.

| Метод | Врем./Пост. | Где работает | Скорость | Примечание / Риск |

|---|---|---|---|---|

| Meta robots: noindex (HTML) | Пост. | Google / Яндекс | Дни / нед. | Не блокируйте страницу в robots.txt — иначе робот не увидит noindex |

| X‑Robots‑Tag: noindex (HTTP) | Пост. | Оба | Дни / нед. | Для PDF/DOC/JPG и пр.; нужна корректная серверная настройка |

| Инструменты удалений (GSC / «Вебмастер») | Врем. | Оба | Часы / дни | В Google — временно (~6 мес.). Без правок на сайте URL вернётся |

| 410 / 404 на странице | Пост. | Оба | Дни / нед. (410 быстрее) | Удалено навсегда; проверьте внутренние ссылки и sitemap |

| 301 / 308 редирект | Пост. | Оба | Дни | Для переноса / слияния; сохраняет сигналы. Нельзя на нерелевантную страницу |

| robots.txt: Disallow | Опер. | Оба | Мгнов. для обхода | Не удаляет уже проиндексированные URL |

| Пароль / HTTP Auth | Врем. / Пост. | Оба | Быстро | Для тестов / интранета; сочетайте с удалением, если URL уже в индексе |

Зачем может потребоваться удалить сайт из поиска

Рассмотрим несколько стандартных ситуаций, когда владелец сайта решает заняться удалением страниц из поисковой системы.

- Старый сайт. Если веб-ресурс не работает, можно убрать его из поиска. Вообще лучше всего настроить редирект со старого домена на новый, но в этой статье предположим, что вы просто хотите его удалить.

- Неактуальные страницы. Например, если информация на странице начинает устаревать или вы изменили публичную оферту, а старая версия находится в поиске. Чтобы не вводить пользователей в заблуждение, лучше сделать ее недоступной.

- Дубли. Иногда в результате технической ошибки или особенностей CMS появляются дубли страниц. Это веская причина убрать их из поиска, чтобы избежать проблем с индексацией.

Важно: даже после полного удаления из индекса поисковиков, копия страницы может сохраниться в сторонних веб-архивах.

Таким образом, несмотря на полное удаление сайта или страницы из поиска, ее теоретически можно будет найти другими способами. Также учитывайте, что для разных поисковых систем способы убрать ресурс из выдачи могут отличаться.

Важное дополнение: ни один из описанных методов не позволит вам удалить чужой сайт, например, ресурс конкурента. Управление доступно только для сайтов, где у вас есть права владельца.

Удаление страницы из «Яндекса»

Существует несколько способов для Яндекса, которые отличаются по техническим нюансам. Выбор конкретного метода зависит от ваших прав доступа к инструментам управления сайтом и желаемой скорости.

Через «Яндекс Вебмастер»

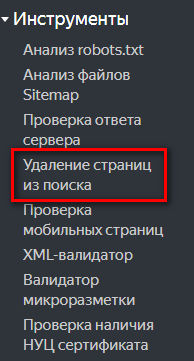

В «Яндекс.Вебмастер» есть встроенный инструмент для удаления ссылок на отдельные страницы из поиска. В меню сервиса находим вкладку «Инструменты» и в выпадающем списке выбираем «Удаление страниц из поиска».

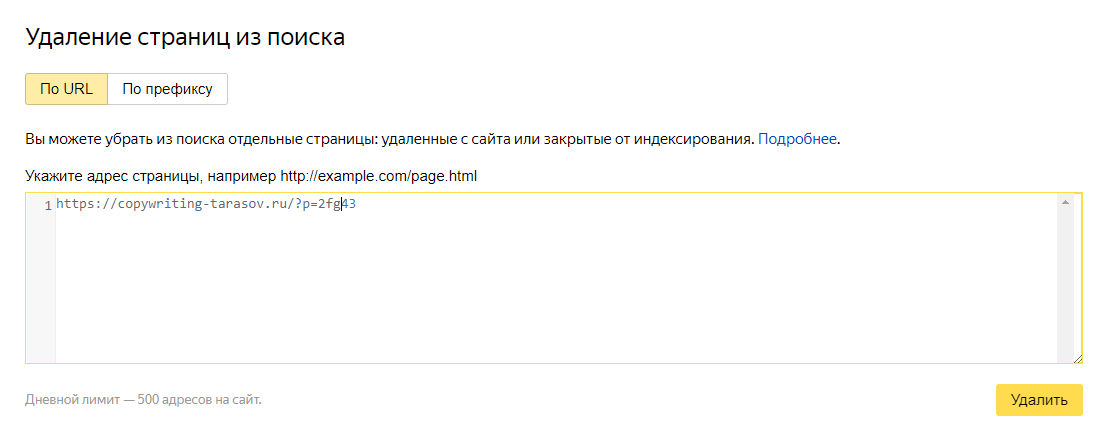

Открывается окно с полем для ввода удаляемых URL. Указываем в поле соответствующие страницы и жмем кнопку «Удалить». За сутки система позволяет отправить на удаление ограниченное количество URL — до 500 штук.

Еще есть вариант удаления «По префиксу». Переходим на соответствующую страницу, кликнув на кнопку «По префиксу». Здесь предлагается два способа удаления. Один через Robots.txt, который мы рассмотрим ниже, а другой — через указание префикса в поле. Например, если нужно исключить из поиска целую группу страниц (скажем, профили пользователей с URL, начинающимися на /profile/), достаточно указать этот префикс и кликнуть «Удалить».

Работа через «Яндекс Вебмастер» — быстрый и надежный способ убрать определённые страницы из поисковой выдачи. После заявки проверяйте статус в разделе «Страницы в поиске» и запускайте «Переобход» для ускорения.

- Инструменты → Удаление страниц → Вставьте URL или префикс.

- Для постоянного эффекта — удалите страницу (410/404) или добавьте noindex.

- Ускорение: «Переобход страниц» + актуальный sitemap.xml.

Удаление страницы (404/410): пошагово

Код ответа 410 Gone — это явный сигнал для поискового робота, что страница удалена навсегда. Google обрабатывает его быстрее, чем стандартный 404 Not Found. Для «Яндекса» разница менее критична, но код 410 все равно является более сильным сигналом.

- Удалите страницу на сайте: верните код ответа 410 (лучше) или 404.

- Уберите все внутренние ссылки и запись из карты сайта (sitemap.xml).

- В «Яндекс Вебмастере» / GSC запросите переобход URL.

- Проверьте спустя 2–14 дней операторами site: и в инструментах вебмастеров.

Если поисковый краулер при очередном переобходе сайта посетит страницу с нужным статусом, он её удалит из поиска. Чтобы робот быстрее пришёл на нужный адрес, отправьте его на переобход в панелях для вебмастеров — это значительно ускорит процесс деиндексации.

Навсегда удалить страницу или файл (404/410 + X‑Robots‑Tag)

Для HTML-страниц: настройте ответ сервера 410 (предпочтительно) или 404, уберите все внутренние ссылки на этот адрес, исключите URL из карты сайта (sitemap.xml) и запросите переобход в «Яндекс Вебмастер» или GSC.

Для файлов (PDF, DOC, JPG): либо физически удалите файл с сервера (он будет отдавать код 404/410), либо сохраните его доступным, но добавьте HTTP-заголовок X‑Robots‑Tag: noindex. Это основной способ управлять индексацией не-HTML документов, не удаляя их.

Пример конфигурации для Apache (.htaccess):

<FilesMatch "\.(pdf|docx|xls|ppt|jpg|png)$">

Header set X-Robots-Tag "noindex, noarchive"

</FilesMatch>

Пример конфигурации для Nginx:

location ~* \.(pdf|docx|xls|ppt|jpg|png)$ {

add_header X-Robots-Tag "noindex, noarchive";

}

Важно: не применяйте блокировку этих URL в файле robots.txt. В противном случае поисковые роботы не смогут выполнить сканирование, чтобы увидеть директиву noindex или код ответа сервера, и страница может остаться в индексе.

1.png)

Удаление сайта из «Яндекса» через robots.txt

Выше уже упоминалось, что удалить отдельные страницы и целые каталоги можно через файл robots.txt. Давайте разберёмся, как это работает. Для запрета посещения поисковыми роботами определённых страниц существует директива Disallow, подробнее про то, как она работает, можно прочитать в нашей статье.

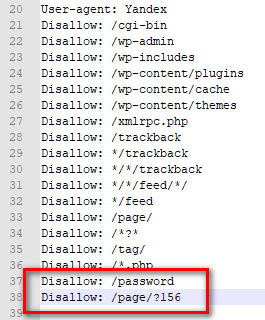

Здесь же мы рассмотрим, как удалять с её помощью страницы из поисковой выдачи. Допустим, нам нужно удалить каталог с персональными страничками пользователей /password, а также отдельную страницу с префиксом /page/?156. Для этого прописываем в файле robots.txt строки, выделенные на скриншоте.

Обратите внимание, что директивы для удаления нужно вводить после указания: User-agent: Yandex. Так вы покажете, что эта директива должна выполняться поисковым роботом «Яндекса».

Важно понимать: директива Disallow в robots.txt не удаляет уже проиндексированные URL. Она лишь запрещает дальнейшее сканирование. Используйте ее для предотвращения индексации новых разделов, а не для деиндексации уже попавших в поиск страниц.

Через метатеги

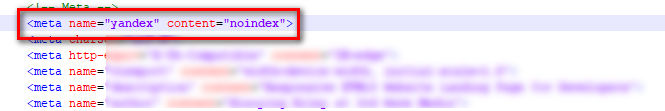

Еще один надежный вариант — запрет индексации через метатеги. Для этого используется стандартный метатег robots, который нужно размещать в секции <head> HTML-кода страницы. Этот способ идеально подходит для отдельных страниц, включая те, что созданы для корпоративных нужд или на чистом HTML.

Вписываем в код страницы между тегами head такую конструкцию:

<meta name="robots" content="noindex, follow">

Параметр noindex запрещает индексирование контента страницы, а follow — разрешает поисковому роботу переходить по ссылкам на ней. Этот тег универсален и работает для обеих поисковых систем. Главное правило: не блокируйте эту страницу в robots.txt, иначе робот не увидит директиву noindex, и страница может остаться в выдаче.

Удаление сайта из Google

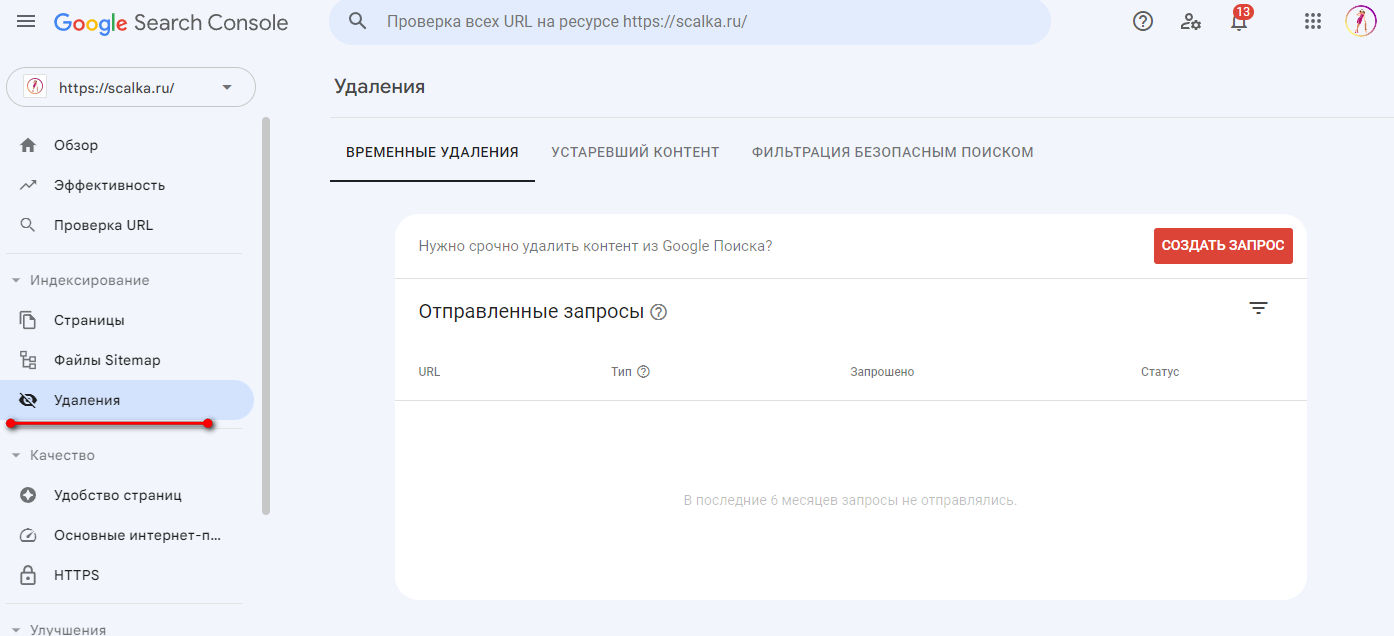

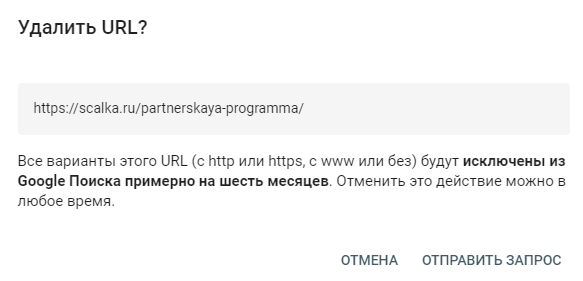

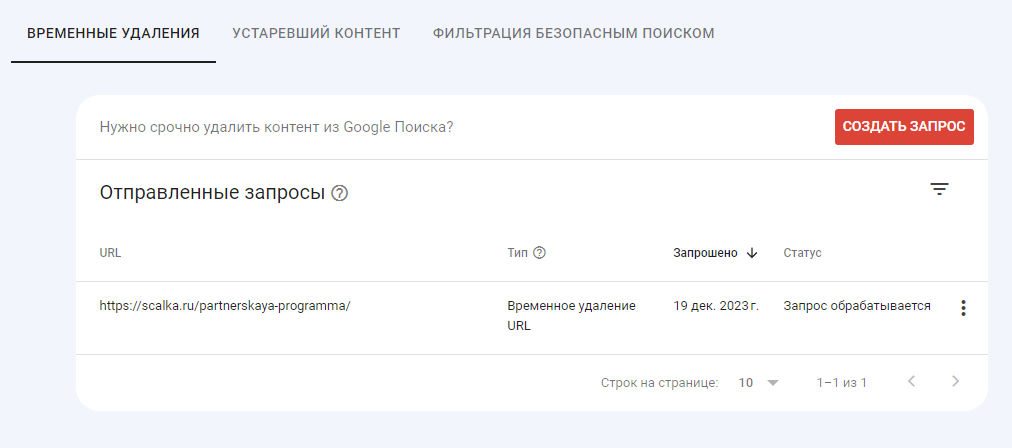

Чтобы убрать сайт из поиска Google, можно воспользоваться инструментом в Google Search Console. В главном меню сервиса найдите раздел «Удаления» и перейдите в него. Затем нажмите кнопку «Создать запрос».

Открывается всплывающее окно, где есть два варианта:

- Временное удаление URL. Этот инструмент обеспечивает быстрое скрытие страницы из результатов поиска. Для постоянного эффекта необходимо также применить один из методов на самом сайте (например, noindex или код 410).

- Удаление кэшированной копии страницы. Здесь можно удалить оставшуюся в кэше копию, если основной контент уже изменен.

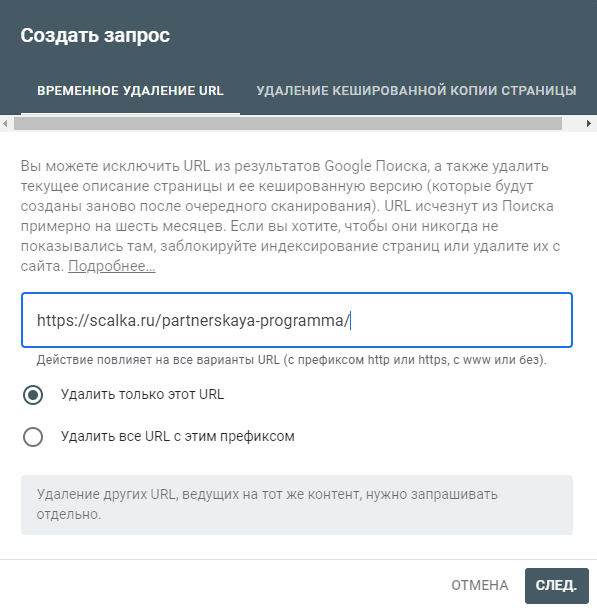

Рассмотрим вариант с временным удалением страницы. Вставляем в поле URL. После чего выбираем «Удалить только этот URL». Если вы хотите удалить, например, категорию товаров из поиска, можно выбрать «Удалить все URL с этим префиксом». В этом случае из выдачи уйдут все документы с таким префиксом. Нажимаем кнопку «След.».

Показывается окно с предупреждением, что страница во всех вариантах будет удалена из поиска. Нажимаем «Отправить запрос».

Теперь на вкладке «Удаление» появилась новая строка. При необходимости вы можете отправить ещё один запрос.

Помимо инструмента «Удаления» и метатега noindex, Google корректно обрабатывает коды ответа 410/404 для исключения страниц и учитывает редиректы 301/308 при переносе. Важно помнить, что инструмент в GSC — это временная мера (блокировка действует около 6 месяцев), и без постоянных изменений на сайте URL со временем вернется в индекс. Запрос на временное удаление обычно обрабатывается в течение суток. После этого подтвердите постоянные изменения на сайте и проверьте статус через инструмент «Проверка URL» для полного контроля над видимостью.

Полезные советы

В заключение — небольшой чек-лист, который поможет принять верное решение по работе с нежелательными страницами сайта и улучшить общую SEO-оптимизацию.

- Удаляйте страницы, контент которых начал устаревать. Все недействительные оферты и карточки отсутствующих товаров лучше убрать из индекса. Это не только вводит пользователей в заблуждение, но и может негативно сказаться на общей позиции сайта в выдаче.

- Способ удаления зависит от поисковой системы. «Яндекс» и Google по-разному реагируют на инструменты, запрещающие индексацию, — учитывайте это.

- Дублируйте запреты. Для надежности лучше использовать несколько способов одновременно, например, noindex и удаление через панель вебмастера.

- Используйте инструменты «Вебмастер» и Search Console. Это позволяет ускорить процесс и получить подтверждение, что страница исключена из поиска.

- При переносе или слиянии страниц используйте 301/308 редирект на релевантный новый URL, а не удаляйте старую страницу — так сохраняются трафик и ссылочные сигналы.

- Проводите периодический технический аудит сайта, чтобы выявлять дубли, «битые» ссылки и страницы, которые являются кандидатами на удаление. Это важная часть поддержания структуры ресурса в порядке.

- Проверяйте результат: используйте оператор `site:` в поиске, а также отчеты в «Яндекс Вебмастере» и GSC. Обращайте внимание на дату последнего обхода и текущий статус индексации, чтобы убедиться в полном удалении.

Коротко о главном

- Удалять из поиска обычно требуется страницы с устаревшим, неактуальным контентом или технические дубли.

- Недостаточно поставить «заглушку» — нужно сообщить об этом поисковым роботам с помощью специальных инструментов или кодов ответа.

- «Яндекс» предлагает несколько разных инструментов для удаления страниц из поиска, включая опции в «Вебмастере» и директивы в robots.txt.

- Google удаляет URL по noindex и корректным кодам 410/404, учитывает 301/308 при переносе; инструмент «Удаление» в GSC — временная мера на ≈6 месяцев.

1.png)

1.png)

1.png)

1.png)

1.png)

.png)

.png)

.png)

Комментарии (7)

Оставить комментарий