Если гугл не индексирует сайт, бизнес теряет органический трафик и потенциальных клиентов. Это критическая проблема, с которой регулярно сталкиваются вебмастера и SEO-специалисты. Почему сайт не индексируется в Google? Причин множество: от банальных опечаток в конфигурационных файлах до сложных серверных блокировок и конфликтов скриптов.

В этом практическом руководстве мы разберем основные технические ошибки, мешающие сканированию, и дадим рабочие алгоритмы их устранения. Ниже рассмотрены 9 наиболее популярных факторов и проверенные методы решения проблемы.

Но сначала проверьте индексацию своего ресурса по чек-листу.

- Быстрый чек‑лист: как понять и исправить индексацию за 10 минут

- Долгая загрузка сайта

- У сайта бесконечный цикл переадресации

- Использование плагинов, блокирующих Googlebot

- Для рендеринга используется JavaScript

- В Google Search Console не указаны все варианты домена

- Установлены метатеги noindex, nofollow

- Штрафные санкции со стороны Google

- Сайт не адаптирован под мобильные платформы

- Проблемы с техническим SEO

- Коротко о главном

Быстрый чек‑лист: как понять и исправить индексацию за 10 минут

Для оперативной диагностики используйте базовый алгоритм. Он поможет локализовать ошибку до глубокого технического аудита.

- Проверьте индексацию: введите в поиск

site:вашдомен.ru. Сопоставьте примерное количество проиндексированных страниц с фактической структурой ресурса. Учитывайте глубину вложенности (рекомендуем 3–4 уровня) и наличие микроразметки. - Google Search Console → Индексирование → Страницы: изучите точные статусы («Проиндексировано», «Обнаружено, не проиндексировано», «Сканировано, не проиндексировано», «Ошибка»).

- Исключите запреты: файл robots.txt не должен содержать глобальную директиву

Disallow: /для нужных разделов. На целевых документах проверьте наличиеmeta robots = index, followи отсутствиеX‑Robots‑Tag: noindexв HTTP‑заголовках сервера. - Проверьте доступность: целевые URL обязаны отдавать код ответа 200 OK. Убедитесь, что нет петель и длинных цепочек 30x редиректов, настроена единая версия домена (https и www/non‑www), а тег canonical указывает на конечный адрес.

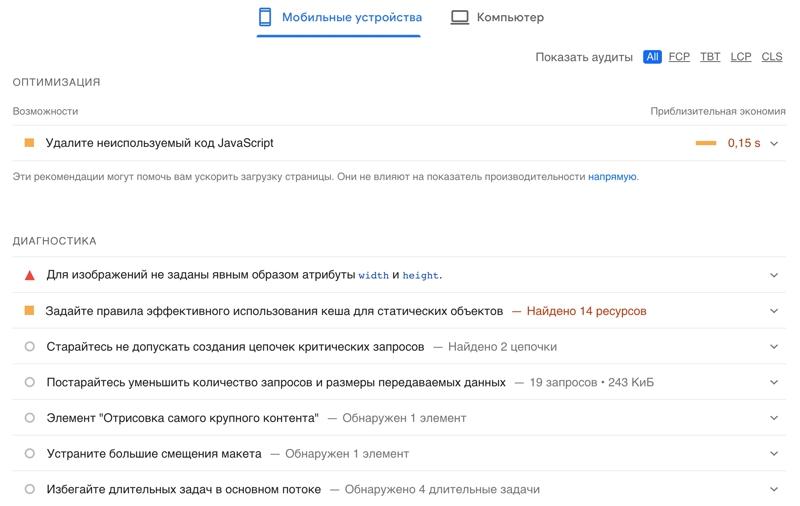

- Скорость и стабильность: оцените метрики Core Web Vitals в PageSpeed Insights. Убедитесь, что системы защиты (WAF, CDN, бот‑фильтры) не блокируют доступ краулеру.

- Карта сайта: sitemap.xml должен содержать исключительно канонические 200‑URL с актуальным атрибутом lastmod. Отправьте файл на проверку в GSC (раздел «Файлы Sitemap»).

- Приоритетные URL: точечно проверьте важные адреса через инструмент «Инспекция URL» в консоли вебмастера и запросите принудительное сканирование.

Долгая загрузка сайта

Долго загружающиеся ресурсы расходуют краулинговый бюджет впустую. Поисковый робот не успевает обойти нужный объем информации за выделенное время, из-за чего новый контент не попадает в выдачу. У медленной работы сервера есть множество причин: от избыточного неоптимизированного кода до использования устаревшего хостинга с ограниченными ресурсами.

Проверить скорость ответа сервера и отрисовки интерфейса можно с помощью двух профессиональных инструментов:

- PageSpeed Insights. Официальный сервис анализирует производительность и дает технические рекомендации. Ориентируйтесь на показатели Core Web Vitals (LCP < 2.5s, INP < 100ms, CLS < 0.1); сводный балл — лишь вспомогательная метрика.

- WebPageTest. Продвинутый инструмент для оценки водопада загрузки (waterfall), который выделяет тяжелые элементы, тормозящие рендеринг.

Переход на более производительный хостинг или подключение CDN (сети доставки содержимого) гарантированно ускорят загрузку и улучшат поведенческие факторы посетителей.

У сайта бесконечный цикл переадресации

Бесконечный цикл переадресации (redirect loop) — критическая ошибка, прерывающая работу алгоритма. Поисковик следует по редиректам, передавая сигналы ранжирования, но при зацикливании процесс останавливается. Это частая причина того, почему гугл не индексирует страницы сайта.

Если проект работает на WordPress или другой популярной CMS, конфигурационный файл .htaccess поможет найти правила, перенаправляющие трафик. Вставьте в поиск текстового редактора Redirect 301, чтобы обнаружить все активные директивы. Исправьте опечатки. Временный 302 редирект обязательно замените на постоянный 301.

С помощью десктопного краулера Screaming Frog SEO Spider можно провести полный аудит и найти битые ссылки. После устранения неполадок воспользуйтесь Google Search Console для повторной отправки запроса. Срок индексации варьируется: от нескольких часов до нескольких недель. Обязательно проверьте, что атрибут rel=canonical указывает на корректный канонический URL без цепочек перенаправлений, и используется строго единая версия домена (https и www/non‑www).

Использование плагинов, блокирующих Googlebot

Некорректная настройка модулей расширения часто приводит к фатальным последствиям. Неправильные правила в robots.txt (в том числе сгенерированные SEO-плагином) могут полностью заблокировать Googlebot. Сам плагин блокировку не создает, проблема кроется в итоговом текстовом файле. Проверьте, что документ доступен по адресу ваш_домен.ru/robots.txt, отдает код 200 и в нем нет Disallow: / для целевых разделов.

Ручная корректировка директив быстро решит проблему. Убедитесь, что в файле отсутствует косая черта в основном правиле:

User-agent: *

Disallow: /

Наличие символа «/» запрещает сканирование всего содержимого от корневой директории. Чтобы поисковик мог получить доступ к материалам, этот знак нужно удалить. Дополнительно проверьте, что доступ краулеру не ограничен на уровне WAF/CDN (например, агрессивные бот‑фильтры Cloudflare) или Basic Auth. Системы защиты иногда принимают роботов за DDoS-атаку.

Для рендеринга используется JavaScript

В процессе рендеринга браузер преобразует исходный код в визуальный интерфейс. Использование JavaScript (особенно Client-Side Rendering) требует от поисковых систем дополнительных вычислительных мощностей. Само по себе применение JS не означает автоматических проблем, но они гарантированно возникнут при попытках маскировки контента.

Маскировка (клоакинг) — это запрещенный приём, при котором ресурс предоставляет живым пользователям и поисковым ботам абсолютно разный контент или отличающиеся URL. Это прямое нарушение рекомендаций для вебмастеров.

Иногда отрендеренная и сырая HTML-версии сильно отличаются, что алгоритм может воспринять как клоакинг. В таком случае процесс добавления в базу остановится. Скрытие системных файлов JavaScript и CSS через robots.txt также не позволит корректно отрисовать макет. Критически важный текст размещайте в чистом HTML; по возможности внедряйте серверный рендеринг (SSR) или статическую генерацию для ключевых посадочных страниц. Официальная позиция поисковика: навигационные ссылки оформляйте как стандартные <a href>, а не через нестандартные события onclick.

В Google Search Console не указаны все варианты домена

В панели вебмастера необходимо добавить и верифицировать все существующие варианты вашего адреса. Это критически важно при миграции с протокола http:// на защищенный https:// или при смене структуры поддоменов. Рекомендуем использовать тип ресурса «Доменный ресурс» (Domain Property), чтобы агрегировать статистику по всем зеркалам.

| Статус GSC | Что проверить | Быстрое решение |

|---|---|---|

| Обнаружено, не проиндексировано | Слабые сигналы/внутренние ссылки | Добавьте внутренние ссылки, обновите контент и lastmod в sitemap |

| Сканировано, не проиндексировано | Ценность/дубли | Улучшите контент; убедитесь, что canonical указывает на себя |

| Дубликат без выбранной канонической | rel=canonical, параметры/UTM | Нормализуйте URL, задайте явный canonical |

| Блокировано robots.txt | Правила Disallow | Разрешите сканирование нужных разделов в robots.txt; для удаления из индекса используйте noindex |

| Исключено метатегом noindex/X‑Robots‑Tag | Шаблоны, HTTP‑заголовки | Уберите noindex/X‑Robots‑Tag там, где нужна индексация |

| Soft 404 | Тонкий/пустой контент | Усильте полезность или верните корректный 404/410 |

Установлены метатеги noindex, nofollow

Случайный запрет на обход — классическая причина того, что сайт не индексируется в гугле. Установка ограничивающих метатегов бывает необходима для служебных разделов (корзина, профиль пользователя). Но если директивы ошибочно попадают в глобальный шаблон, весь проект выпадает из поиска.

Удалите noindex на продвигаемых страницах и обязательно проверьте отсутствие X‑Robots‑Tag: noindex в HTTP‑заголовках сервера (часто генерируется из-за неверной настройки Nginx или Apache). С 2019 года атрибут nofollow воспринимается алгоритмами как подсказка, а не строгий приказ. Он не передает ссылочный вес, но сам по себе не мешает сканированию целевого документа.

%201.png)

Штрафные санкции со стороны Google

За применение черных методов оптимизации ресурс может попасть под жесткую пессимизацию. Штрафные санкции накладываются как вручную командой асессоров, так и автоматически — после обновления ядра алгоритмов.

До тех пор, пока нарушения полностью не устранены, google не индексирует сайт или искусственно занижает его позиции. Чаще всего фильтры применяются за наличие:

- вредоносного кода и нежелательного программного обеспечения;

- скрытого текста и невидимых ссылок;

- клоакинга (маскировки);

- намеренной скрытой переадресации на сторонние ресурсы;

- переспама нерелевантными ключевыми словами;

- неестественного ссылочного профиля;

- массового дублированного или малополезного контента (Thin Content).

Сайт не адаптирован под мобильные платформы

Адаптация интерфейса под мобильные устройства — это базовое техническое требование. Поисковик использует mobile‑first индексацию по умолчанию: оценка качества, релевантности и само сканирование происходят исключительно на основе мобильной версии документа. Отдельного десктопного краулера для формирования основной выдачи больше нет.

Для соответствия стандартам достаточно внедрить адаптивный дизайн (Responsive Web Design). Плавающая сетка позволяет макету корректно трансформироваться под любые размеры экрана смартфона. Медиавыражения (Media Queries) дают возможность CSS-стилям перестраивать блоки без потери читабельности. Важно: избегайте отложенной загрузки (lazy load) для основного текстового блока, иначе бот его просто не увидит.

Специальный инструмент Google позволит быстро проверить оптимизацию для смартфонов. Он укажет на слишком мелкий шрифт, близко расположенные интерактивные элементы или контент, выходящий за пределы экрана.

Проблемы с техническим SEO

Технический аудит — фундамент успешного продвижения. Именно грамотная внутренняя оптимизация помогает поисковым системам беспрепятственно сканировать структуру, понимать иерархию и сохранять данные в индекс. Если вы ищете ответ на вопрос, почему сайт не индексируется в гугле, начинать диагностику нужно именно с серверной части.

Профессиональное техническое SEO идентифицирует проблемы с основными интернет-показателями и краулинговым бюджетом. Проверьте стабильность кодов ответа: строго 200 для продвигаемых URL, полное отсутствие 4xx/5xx ошибок, мягких редиректов (Soft 404) и длинных цепочек 30x. Убедитесь, что sitemap.xml содержит только канонические адреса с актуальным тегом lastmod и успешно отправлен в панель вебмастера. Удалённые, мусорные и неканонические адреса категорически не должны попадать в карту сайта, так как это замедляет обход и путает алгоритмы.

Коротко о главном

- Чтобы digital-проект приносил реальную прибыль бизнесу, важно размещать экспертный материал, регулярно проводить технический аудит и наращивать качественную ссылочную массу. Но любые маркетинговые усилия бессмысленны, если ресурс технически закрыт от сканирования.

- Сформируйте ТЗ для разработчиков на основе нашего чек-листа. Убедитесь, что все серверные барьеры устранены, дубли склеены, а директивы настроены правильно. Только после полного устранения технических ошибок поисковая система отблагодарит ваш проект стабильным ростом позиций и целевым органическим трафиком.

%201.png)

%201.png)

%201.png)

%201.png)

%201.png)

.png)

.png)

.png)

Комментарии (10)

Оставить комментарий