Как мы автоматизировали процесс обновления статей в блог с помощью RAG-агента

О контент-фермах не слышал только ленивый. Множество бизнесов отдают контент на откуп нейросетям, мы тоже используем ИИ для написания и обновления контента. В январе 2026 мы разработали собственного AI-агента и выстроили систему обновления статей блога kokoc.com. Это позволило сэкономить на услугах редакции и автоматизировать процесс апдейтинга.

Но есть нюанс: мы не уповаем только на ИИ. Берем статьи, написанные экспертами компании и профессиональными авторами, и дорабатываем их с помощью агента, не теряя в качестве и самобытности. А потом еще проверяем с помощью редакции — без человеческого участия в этом процессе не обойтись.

Анамнез

В блоге нашего сайта kokoc.com более 1 200 статей. Мы системно ведем блог с 2021 года, порой выпускали по 30 статей в месяц, но постепенно эти тексты устаревают и начинают приносить меньше трафика.

Мы периодически обновляли контент силами редакции, но это обходилось достаточно дорого. Стоимость полного обновления материалов исчислялась миллионами рублей. Плюс время — на переработку всех статей ушло бы года два. За это время обновленные материалы снова бы устарели… и всё пришлось бы начинать сначала.

Когда Павел Талакин в очередной раз сел считать экономику апдейтов, стало очевидно, что делать актуализацию текстов силами редакции долго и дорого. Нужно было автоматизировать процесс и найти инструмент, который сможет обновить материалы качественно и быстро. В 2025 году мы уже запустили и обкатали несколько универсальных версий ИИ-агентов на базе n8n для написания различного типа контента (об одном из них мы писали в кейсе «Убийца копирайтеров»). Но для блога Kokoc.com требовалась адаптация и усложнение логики.

Нужно было не просто обновить текст, а сделать полную автоматизацию, которая позволит проверить статью на актуальность информации, точечно доработать текст с учетом требований SEO и GEO, сохранить важные детали (стиль, картинки, интерактивные блоки, перелинковку на услуги и другие статьи), сделать микроразметку, завернуть все это в валидный html-код для нашей cms и выдать полную сводку редактору для проверки. То есть получить полностью готовый выверенный материал, который бы проходил фактчекинг и ускоренную вычитку в редакции и отправлялся на публикацию с минимальным вмешательством ручного труда.

Мы решили перейти от обычного ИИ-агента к агенту с подключаемой RAG-базой данных.

Представьте разницу: обычный ИИ — это начитанный стажер, который пытается отвечать по памяти и часто фантазирует. А RAG-агент — это педантичный эксперт. Прежде чем ответить, он погружается в корпоративную базу знаний, находит нужный регламент и выдает точную выжимку. Никакой отсебятины — только проверенные факты из наших внутренних источников

В январе 2026 года мы плотно занялись этой задачей.

Сложности и особенности проекта

Результаты

Всего за месяц работы мы обновили чуть менее 10% статей и уже добились значимых результатов.

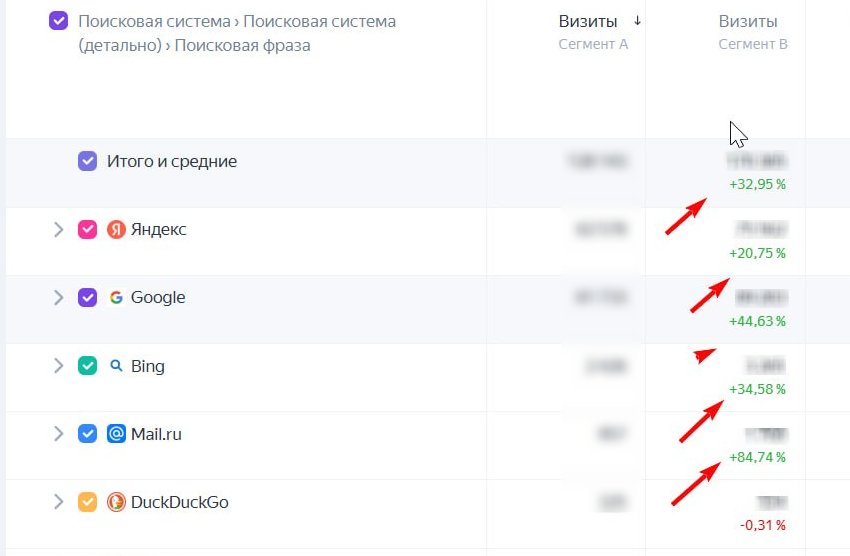

Рост трафика

Обновленные статьи мы начали публиковать в марте и в конце месяца обнаружили прирост поискового трафика месяц к месяцу в 32%. И это всего лишь 10% из тех статей, которые мы хотим обновить, а значит - это только начало.

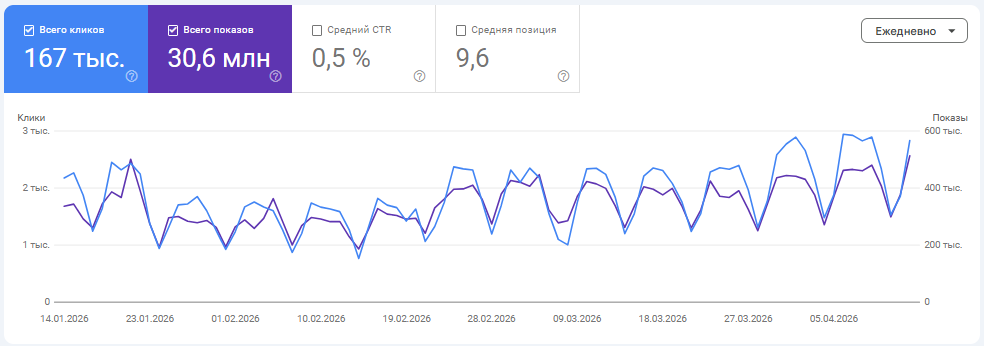

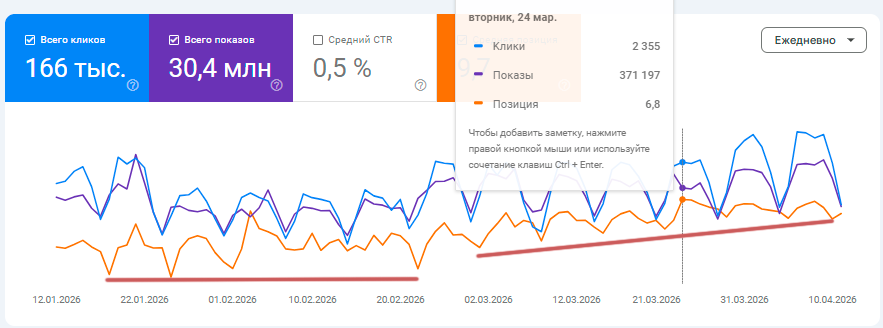

Рост кликов и показов

За три месяца мы получили 166 000 кликов, средний CTR равен 0,5. Количество показов — 30,6 млн.

Рост средней позиции

В марте 2026 выросла средняя позиция — с 10 до 6,8, что свидетельствует о положительной динамике.

Снижение стоимости

Мы сравнили стоимость обновления одной статьи (с учетом оплаты работ автора и редактора) до внедрения агента и после. Затраты снизились на 80% — осталась только необходимая редакторская проверка.

Снижение временных затрат

Обновление статьи от запуска до готовности на агенте занимает 1 час. Это в 20-30 раз меньше, чем если бы апдейтами занималась редакция. Вот что мы получаем:

-

У специалистов высвобождается время на творческие задачи, глубокую аналитику и поиск нестандартных решений.

-

Более качественный и стабильный результат работы. Метрики проверки качества позволяют его поддерживать.

-

Скорость выполнения и соблюдение сроков (ИИ-агенты не болеют).

-

Снижение себестоимости продукта.

Мы решили протестировать, как работает RAG-база в нейросетях, и прикрутить ее к имеющемуся ИИ-агенту. Немного теории: RAG-база — это сторонняя база знаний по нашей тематике, к которой обращается агент в процессе актуализации контента. Помимо данных с сайта Kokoc.com, наших публикаций и кейсов, агент берет актуальные данные с разных Telegram-каналов, из других трастовых SEO-шных источников и опирается на них при доработке текста.

Предварительно мы собрали векторные базы данных по нашей тематике и компании. При анализе и написании текстов LLM-модели теперь используют и наши данные, и те, на которых они обучались. Информация в базах пополняется по мере работы.

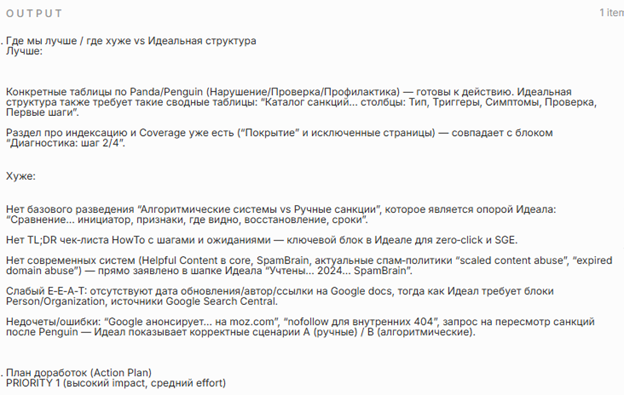

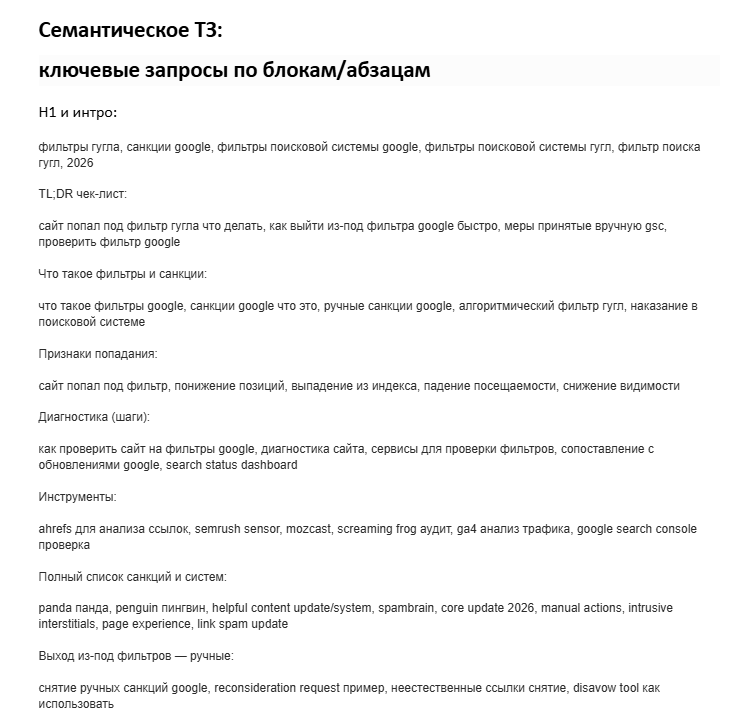

Мы не пишем статью с нуля и не хотим кардинально переписывать авторский материал — обновление заключается в том, чтобы обнаружить наиболее критичные проблемы и устранить их. В первую очередь вручную собираем семантику, ищем хорошо ранжируемые статьи конкурентов, загружаем их в LLM и получаем идеальную структуру страницы, которую хотел бы видеть Google в ответ на запрос пользователя.

Далее агент с помощью сложного промпта сопоставляет текст статьи, которую надо обновить, с этой идеальной структурой, и дает рекомендации по доработкам:

- Раскрыть такой-то интент с помощью чанка (блока информации).

- Добавить наглядную таблицу, картинки.

- Добавить определение в начале текста.

- Усилить E-E-A-T-факторы.

- Обновить устаревшую информацию.

- Убрать недостоверные данные, ошибки в формулах и т.д.

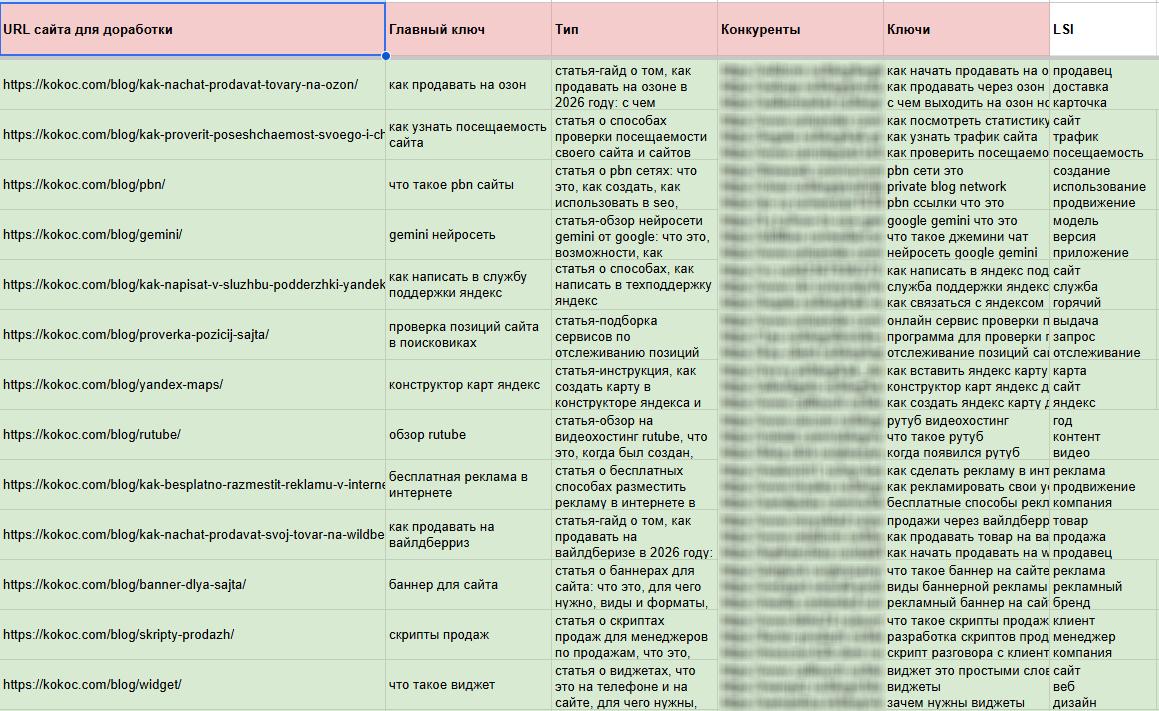

Так работает модуль анализа страницы — сопоставляет исходную статью с идеальной структурой:

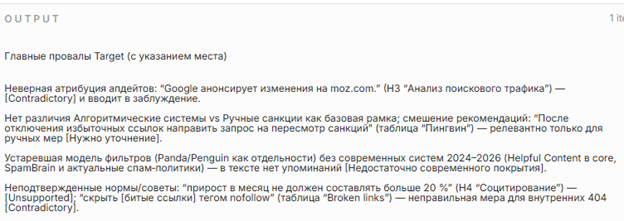

А вот конкретные рекомендации по доработкам:

И рекомендации по семантике:

Все найденные проблемы оцениваются и приоритизируются. Каждый пункт исследуется и подкрепляется референсами из базы данных и новейших публикаций. Затем Агент начинает доработку согласно своим же рекомендациям.

У нас есть два варианта доработки. Если исходная статья слабо ранжируется, нужна глобальная доработка, если достаточно хорошо — минимальная, по приоритетным рекомендациям. Минимальная доработка позволяет не тратить много ресурсов — зачем сильно улучшать то, что работает нормально?

При обновлении текста учитываются также следующие нюансы:

- Мимикрия под автора статьи. Этот прием мы используем и в наших универсальных ИИ-агентах, только в данном случае образец для подражания уже «зашит» в Агента и не требует дополнительных пояснений в стиле «напиши вот так».

- Перелинковка на статьи и услуги Kokoc Performance. Агент проверяет обновленный текст на актуальность перелинковочных блоков, убирает устаревшие шорт-коды и добавляет правильные согласно ТЗ.

- Микроразметка. В дополнение к автоматической базовой микроразметке статей Агент добавляет разметку терминов, изображений, блоков FAQ, если находить их в коде основного содержания страницы.

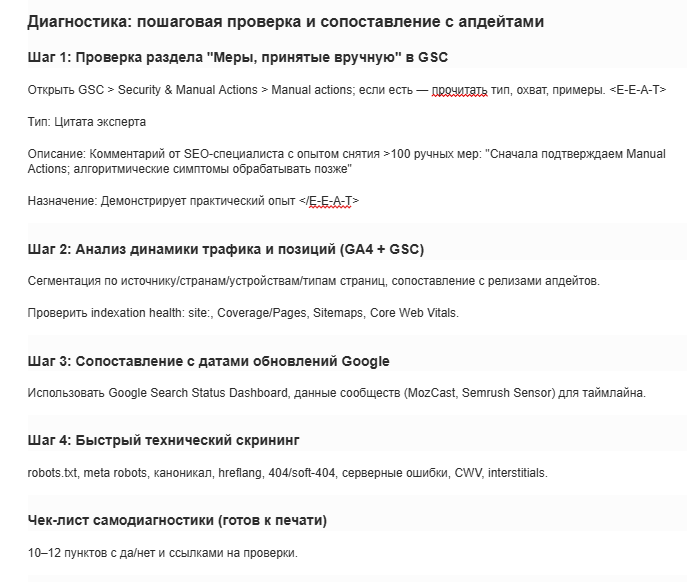

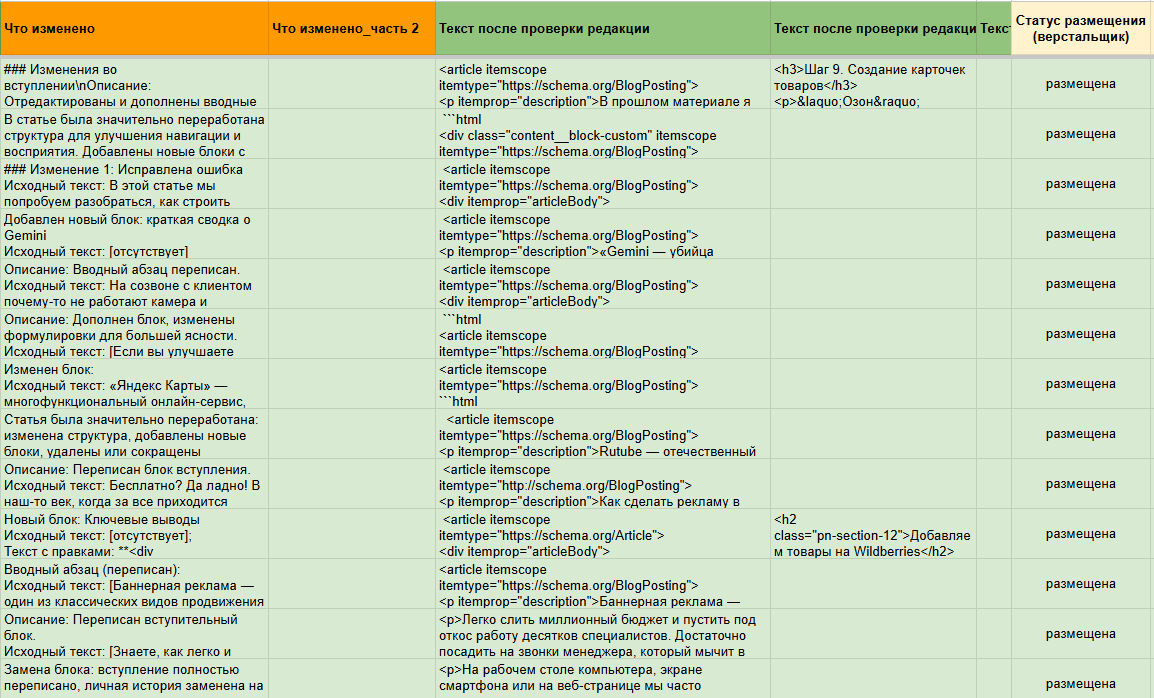

- Работа в одном окне. Каждый шаг фиксируется в единой Google-таблице, к которой есть доступ у оптимизатора, ИИ-агента, редактора и верстальщика. Оптимизатор собирает исходные данные и ставит задание в работу. ИИ-агент по расписанию забирает задания и дорабатывает статьи, возвращая результат в ту же таблицу. Далее идет работа редакции — редактор получает уже исправленный Агентом текст в виде кода и информацию о том, что было изменено, его задача — финально проверить и верифицировать текст. По окончании верстальщик забирает готовый код и обновляет статью на сайте.

В таблице отражена SEO-составляющая: ключи, LSI-слова, статьи конкурентов

Указано, что именно было заменено, вносится код после проверки редакцией и выставляется статус (размещена, в работе и т. д.):

Еще одна задача по статьям в блоге, которую хотелось автоматизировать — процесс ответов на комментарии пользователей к статьям. Реализовали его с помощью другого Агента по следующему алгоритму:

- Специальный скрипт выгружает новые комментарии из Битрикса в рабочую таблицу.

- Агент по расписанию забирает новые комментарии без ответов.

- Получает текст статьи, изучает тему статьи и вопрос читателя (или цепочку вопросов).

- Составляет ответ и выгружает его в специальную таблицу/форму. Ставит статус к публикации.

- Другой модуль проверяет ответ на релевантность и верифицирует.

- Скрипт забирает новые ответы на комментарии и выгружает их в Битрикс.

- Ответы автоматически добавляются на сайт.

- Автоматизация — это не отказ от людей, а перераспределение бюджета. Мы не сократили редакцию, но изменили ее роль. Редактор стал заниматься только фактчекингом и верификацией результата работы ИИ. За счет снижения стоимости обработки одной статьи общие затраты на блог снизились на 80%. А это миллионы рублей, которые мы можем потратить на решение других трудоемких задач.

- RAG-агент — это актив, который дорожает со временем. Разработанный RAG-агент и накопленная база знаний (векторные БД) становятся инфраструктурой компании. Чем больше статей мы обновляем, тем умнее становится база и тем меньше времени требуется на настройку следующих итераций. Успех проекта определила не сама нейросеть, а сложные промпты и модуль «мимикрии под автора», которые мы заложили в Агента. Мы заставили нейросеть соблюдать стиль автора и технические требования, не превращая уникальный экспертный материал в безликий SEO-текст. Без этого мы бы получили типичный контент с контент-фермы, который Google перестает ранжировать.

- Успех проекта определила не сама нейросеть, а сложные промпты и модуль «мимикрии под автора», которые мы заложили в Агента. Мы заставили нейросеть соблюдать стиль автора и технические требования, не превращая уникальный экспертный материал в безликий SEO-текст. Без этого мы бы получили типичный контент с контент-фермы, который Google перестает ранжировать.

.png)

.png)

.png)